챗GPT 이용 AI 소총 논란…"명령 즉시 조준→발사"

Master

0

1

0

0

7시간전

Master

0

1

0

0

7시간전

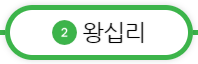

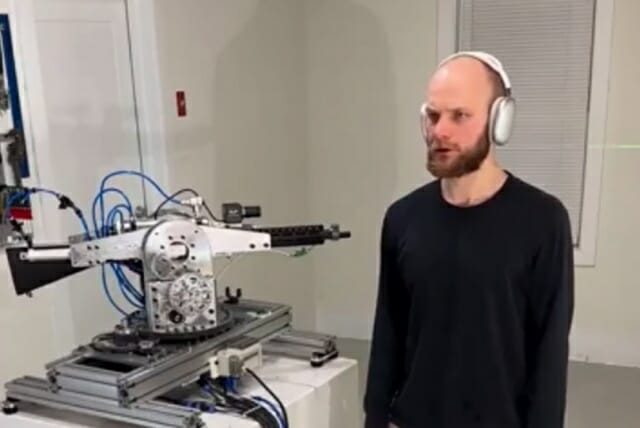

오픈AI의 챗GPT를 활용해 만든 인공지능(AI) 자동 소총 영상이 올라와 논란이 되고 있다고 IT매체 기즈모도가 9일(현지시간) 보도했다.

온라인 커뮤니티 레딧에 올라온 영상에서 개발자가 AI 소총에게 발사 명령을 내리자 소총은 이에 반응해 조준하고 총알을 발사한다.

이 개발자는 “챗GPT, 우리는 전면 왼쪽과 오른쪽에서 공격을 받고 있다”며, “적절하게 대응하라”고 말한다. 소총이 반응하는 속도와 정확도는 인상적이다.

이 AI 시스템은 오픈AI가 최근 출시한 리얼타임 API에 의존해 사용자의 명령을 해석한 다음 이를 구현했다. 챗GPT가 “왼쪽으로 돌려”(Turn Left) 같은 명령을 받아 이를 기기가 읽을 수 있는 언어로 구현하는 방법은 간단한 훈련만이 필요하다고 기즈모도는 전했다.

오픈 AI는 성명을 통해 해당 영상을 보고 이를 만든 개발자들 차단했다고 밝혔다. "우리는 정책 위반을 사전에 파악했고, 문의를 받기 전 이 활동을 중단하라고 개발자에게 알렸다"고 밝혔다.

AI 기술에 대한 우려 중 하나는 무기를 자동화할 수 있는 점이다. 오픈AI의 멀티모달 모델은 음성 및 시각적 입력을 해석하여 사람의 주변 환경을 이해하고 그들이 보고 있는 것에 대한 질문에 응답할 수 있다. 이미 자율주행 드론은 개발 중이며, 인간의 명령 없이도 전장에서 목표물을 식별하고 공격하는 데 사용될 수 있다.

전장에서 AI 사용을 지지하는 사람들은 군인들이 최전선에서 벗어나 미사일 저장고와 같은 표적을 무력화하거나 원거리에서 정찰을 수행할 수 있게 돼 군인들을 더 안전해 질 것이라고 말하고 있다. AI 구동 드론은 정밀한 공격이 가능하기도 하다.

하지만, 이 기술은 어떻게 사용되느냐에 달려 있기 때문에 위험은 존재한다고 해당 매체는 전했다.

오픈AI는 자사 제품을 사용하여 무기를 개발하거나 사용하거나 개인 안전에 영향을 미칠 수 있는 특정 시스템을 자동화하는 것을 금지하고 있다.

하지만, 작년 말 오픈AI는 AI 드론과 미사일을 만드는 미국의 방산업체 안두릴(Anduril)과 협력해 자사의 소프트웨어를 안두릴의 대(對) 드론 시스템(CUAS)에 통합할 예정이라고 밝혀 일부에서는 우려를 표하기도 했다.