SK하이닉스, 아마존 AI 투자 수혜…HBM3E 12단 공급 추진

Master

0

4

0

0

9시간전

Master

0

4

0

0

9시간전

AWS(아마존웹서비스)가 SK하이닉스 HBM(고대역폭메모리) 사업의 핵심 고객사로 떠오르고 있다. 전 세계 AI 데이터센터 구축에 막대한 투자를 진행하는 한편, 국내에서도 SK그룹과의 협력 강화를 도모하고 있어서다.

나아가 AWS는 이르면 올해 말 자체 개발한 3세대 AI칩 출시를 계획하고 있다. 이에 SK하이닉스도 현재 HBM3E 12단 제품을 적기에 공급하기 위한 준비에 나선 것으로 파악됐다.

17일 업계에 따르면 SK하이닉스는 AWS의 AI 인프라 투자에 따라 HBM 사업 확장을 추진하고 있다.

AWS는 SK하이닉스 HBM 사업에서 엔비디아의 뒤를 이을 핵심 고객사로 자리잡고 있다. 전 세계적으로 데이터센터 확장을 추진하고 있고, 차제 ASIC(주문형반도체) 개발로 HBM에 대한 수요량도 늘려가고 있기 때문이다.

일례로 AWS는 지난 14일(현지시간) 올해부터 오는 2029년까지 호주 내 데이터센터 확충에 200억 호주달러(한화 약 17조6천억원)를 투자한다고 발표했다. 앞서 이 회사는 미국 노스캐롤라이나주에 100억 달러, 펜실베니아주에 200억 달러, 대만에 50억 달러 등을 투자하기로 한 바 있다. 올해 AI 인프라에 쏟는 투자금만 전년 대비 20%가량 증가한 1천억 달러에 달한다.

SK그룹과의 협력 강화도 기대된다. AWS는 SK그룹과 협력해 올해부터 울산 미포 국가산업단지 부지에 초대형 AI 데이터센터를 구축할 계획이다. 오는 2029년까지 총 103MW(메가와트) 규모를 가동하는 것이 목표다. AWS는 40억 달러를 투자할 것으로 알려졌다.

AWS의 AI 데이터센터 투자는 HBM의 수요를 촉진할 것으로 기돼된다. HBM은 여러 개의 D램을 수직으로 적층해, 기존 D램 대비 데이터 처리 성능을 크게 끌어올린 메모리다. AI 데이터센터용 고성능 시스템반도체에 함께 집적된다.

현재 AI용 시스템반도체는 엔비디아 GB200, GB300 등 '블랙웰' 칩이 시장을 주도하고 있다. 업계에 따르면 올해 AWS가 엔비디아의 GB200·GB300 전체 수요에서 차지하는 비중은 7%로 추산된다.

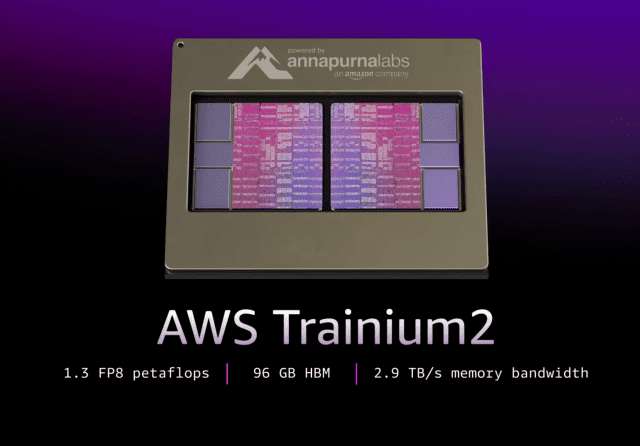

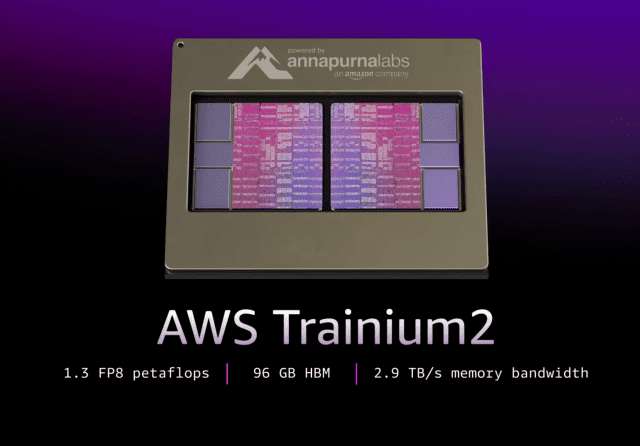

동시에 AWS는 머신러닝(ML)에 특화된 '트레이니엄(Trainium)' 칩을 자체 설계하고 있다. 해당 칩에도 HBM이 탑재된다. 지난해 하반기 출시된 '트레이니엄 2'의 경우, 버전에 따라 HBM3 및 HBM3E 8단 제품을 채택했다. 최대 용량은 96GB(기가바이트)다.

이르면 올 연말, 혹은 내년에는 차세대 칩인 '트레이니엄 3'를 출시할 계획이다. 이전 세대 대비 연산 성능은 2배, 전력 효율성은 40%가량 향상됐다. 총 메모리 용량은 144GB(기가바이트)로, HBM3E 12단을 4개 집적하는 것으로 파악됐다. HBM3E 12단은 현재 상용화된 HBM 중 가장 고도화된 제품이다.

SK하이닉스도 이에 맞춰 AWS향 HBM3E 12단 공급을 준비 중인 것으로 알려졌다.

반도체 업계 관계자는 "아마존이 자체 AI 반도체 생산량 확대에 본격 나서면서 HBM3E에 대한 관심도 크게 높아졌다"며 "SK하이닉스는 지난해에도 AWS에 HBM을 상당량 공급해 왔고, 현재 트레이니엄 3 대응에도 적극적으로 나서는 분위기"라고 말했다.